卷积神经网络的重要性 |机器学习

卷积神经网络顾名思义是一种利用卷积运算进行分类和预测的神经网络。

让我们分析一下卷积神经网络相对于简单深度学习网络的用例和优势。

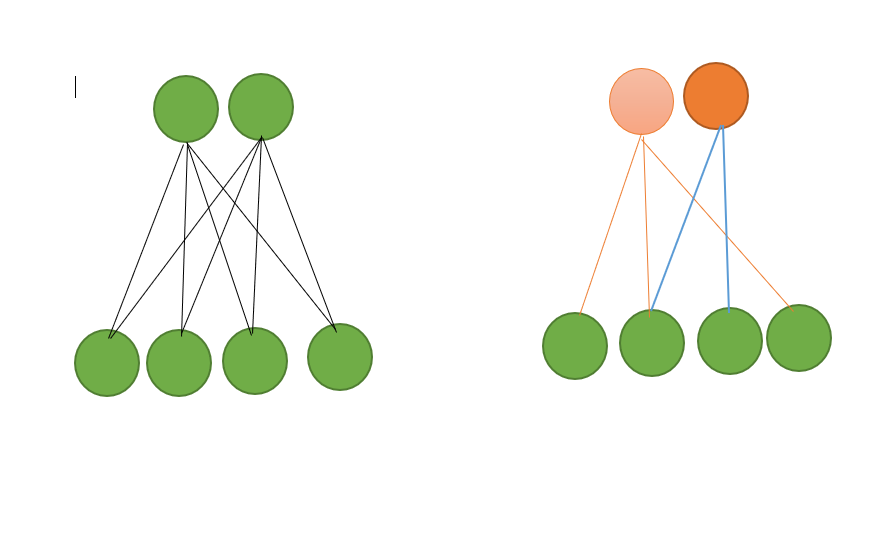

权重分享:

它利用局部空间相干性为某些边提供相同的权重,通过这种方式,这种权重共享最大限度地降低了计算成本。这在 GPU 低功耗或缺失时特别有用。

内存节省:

减少的参数数量有助于节省内存。例如,在 MNIST 数据集识别数字的情况下,如果我们使用具有单个隐藏层和 10 个节点的 CNN,则需要几百个节点,但如果我们使用简单的深度神经网络,则需要大约 19000 个参数。

独立于图像的局部变化:

让我们考虑一下我们是否正在训练我们的全连接神经网络以使用人的头像图像进行面部识别,现在如果我们在一个不是头像而是全身图像的图像上测试它,那么它可能无法识别。由于卷积神经网络利用了卷积运算,因此它们与图像中的局部变化无关。

等方差:

等方差是 CNN 的属性,可以看作是一种特定类型的参数共享。从概念上讲,如果在输入发生变化时,类似的变化反映在输出中,则可以将函数视为等方差。在数学上,它可以表示为f(g(x)) = g(f(x)) 。事实证明,卷积与许多数据转换操作是等效的,这有助于我们识别输入的特定变化将如何影响输出。这有助于我们识别输出中的任何剧烈变化并保持模型的可靠性。

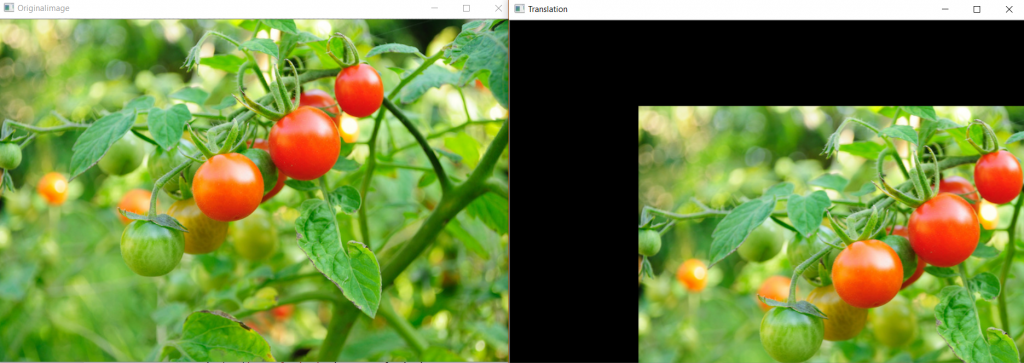

独立于转换:

CNN 更独立于几何变换,如缩放、旋转等。

翻译独立的例子——CNN正确识别对象

旋转无关性示例——CNN正确识别对象